MCP 是什麼?從 生成式AI 走向 Agentic AI 的關鍵基礎

如果說第一階段的 AI 浪潮,重點在於讓 AI 學習人類的表達方式;那麼我們現在正處於第二階段的開端,這一階段的核心是「行動」,即 Agentic AI (代理式 AI)。

Agentic AI 不再只是被動回答問題,而是具備自主決策能力的數位員工。它需要能夠跨越不同系統行動,例如查詢企業內部資料、更新狀態,或在協作工具上通知相關人員。然而,直到近年,要讓 AI 安全、穩定地執行這類跨系統任務,整體成本仍然非常高昂。

AI 是怎麼順利地從生成式 AI 進化成 Agentic AI ?

這一切的關鍵就是今天的主角—— MCP (Model Context Protocol,模型上下文協定)。

背景:MCP 誕生前的「整合地獄」

在深入討論 MCP 的運作前需要先釐清一個問題:為什麼 AI 的能力不斷提升,卻仍然很難在企業中真正使用?關鍵往往不在模型,而在碎片化的數據環境。

企業的資料與工具往往分散在不同系統中:文件可能存放在 SharePoint,製造資料存放在MES,客戶資料則位於 Salesforce,彼此之間缺乏一致的連接方式。當企業希望讓任何一個模型都能存取任意一個資料來源時,工程團隊通常只能採取最直接的做法——針對每一種模型與系統的組合,單獨撰寫一段整合程式,也就是所謂的「膠水代碼(Glue Code)」。

在這樣的架構下,開發者必須為每一種模型與每一種工具的組合,反覆撰寫膠水代碼。由於缺乏統一的連接規範,任何一個系統 API 的版本變動,都可能牽動數十個既有的整合點,使整體系統的穩定性大幅降低。

最終,這種點對點的對接模式會陷入工程團隊口中的「整合地獄(integration hell)」。

久而久之,這種高度客製、難以重用的整合方式,會帶來兩個明顯後果:

- 供應商鎖定:當企業已為某一套模型投入大量整合成本,想要切換到其他模型,往往意味著必須重新撰寫與測試整套連線。

- 資料孤島被進一步固化:由於每新增一個資料來源,都代表一段新的整合成本,企業通常只先接入最核心的系統,將大量零散但有價值的資料排除在 AI 的視野之外。

這也是為什麼許多 AI 專案即使概念成熟,最終仍停留在示範階段,因為整合本身的成本與風險過高。

技術與優勢:MCP 三大核心組件

終於,2024年11月美國新創 Anthropic 推出 MCP,終結這場混亂。

MCP 並不是要成為包山包海的超級平台,也不是讓 AI 學一種新語言,而是替 AI 和系統之間,訂一套「溝通規則」。

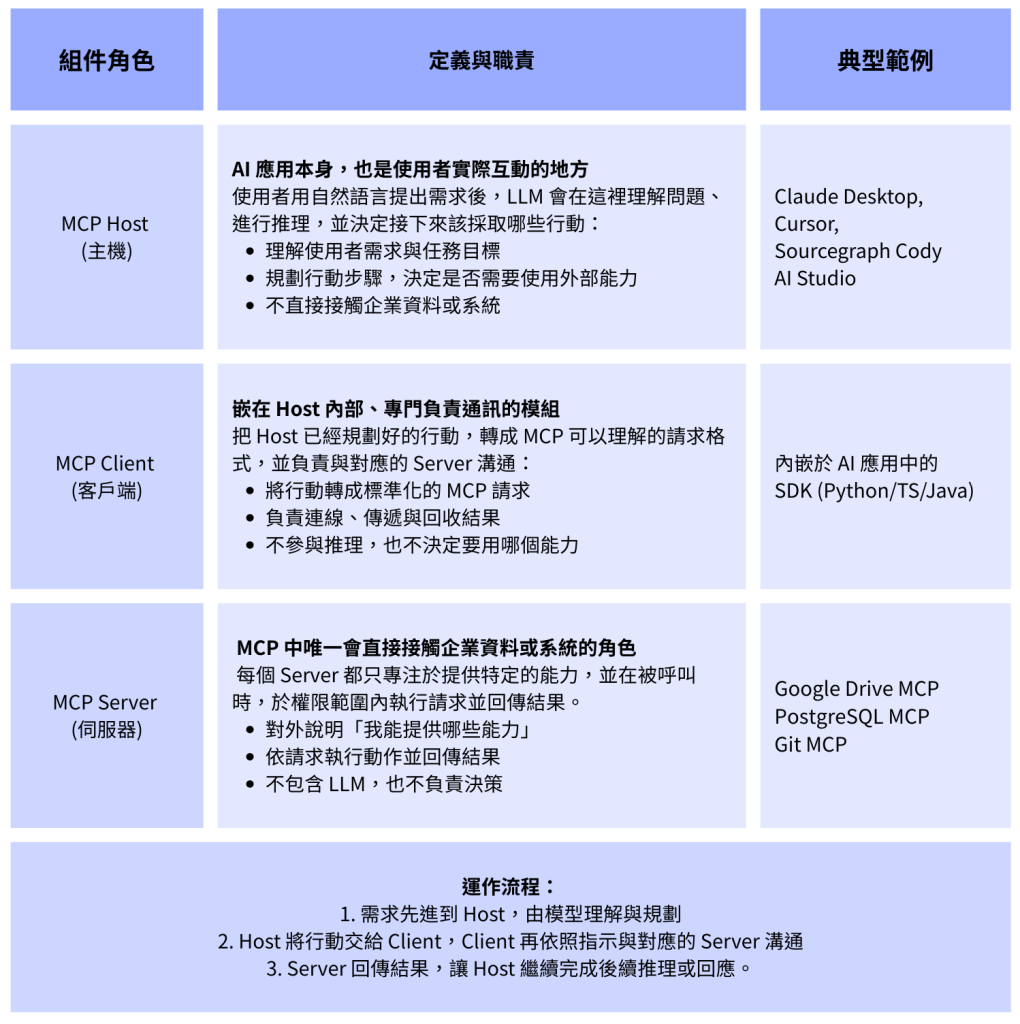

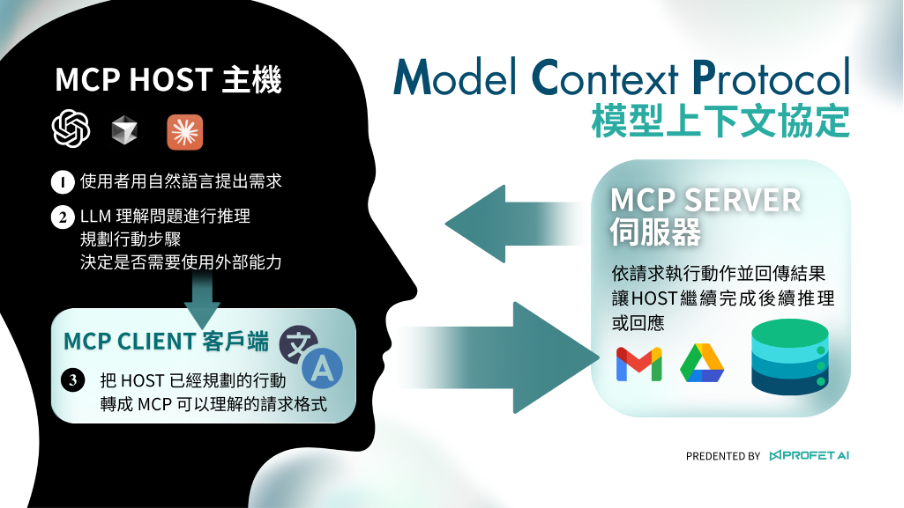

MCP 架構由三部分組成:MCP Host、MCP Client 、MCP Server。

對開發團隊來說,這意味著不必再為每一個 AI 工具或平台各寫一套整合。只要完成一次對應的 MCP Server,就能被不同的 AI 應用環境重複使用,不論是桌面型 AI 工具、開發者 IDE,還是企業內部自建的平台,都能直接接上。

當連接方式可以被重用,整合成本也就不再不斷累積,也讓 AI 應用的開發與維護,開始回到更可控、也更可持續的狀態。當整合成本被控制,Agentic AI 才有機會真正走進企業的日常流程。

可是,跨過了「整合地獄」卻還有一道難關,名為:資安與權限。

MCP 的「邊界感」:AI 權限 與 企業資安

當 AI 開始進入企業流程,真正關鍵的從來不是它「能做多少事」,而是它被允許做到什麼程度,以及這些權限會不會帶來入侵或洩漏企業內部資訊的風險。

因此,在 MCP 的設計裡,AI 並不是被允許隨意操作系統,而是被刻意限制在清楚定義好的互動範圍內。有些情況下,AI 只需要讀取資訊,用來理解狀態或判斷問題;但一旦涉及更新資料、發送通知,或觸發實際動作,風險就會隨之出現。也正因如此,這類行為必須被明確規範,只能在被允許的條件下執行。同時,當使用者切換專案或工作內容改變時,AI 可見的資料範圍也會隨之更新,避免長期持有不必要的權限。

這樣的「邊界感」,並非多此一舉。2026年初被稱為 Ni8mare 的資安事件便是一個提醒:當自動化或 AI 平台同時握有系統存取權限與跨流程控制能力,一旦被入侵,影響的就不只是單一工具,而是整條營運流程。此時,風險不再來自某個功能,而是來自流程本身。

對企業而言,特別是製造業,資安同時也意味著數據主權。MCP 並不要求將原始資料送往雲端,而是支援在本地完成整理與過濾,只將必要的結果交給模型進行推理。資料仍然留在企業手中,AI 則扮演輔助分析的角色。

這樣的設計,讓 AI 在開始具備行動能力的同時,仍然保留了企業最在意的控制感。AI 不再只是被動回答問題,但它的每一次行動,仍然發生在可被理解、可被管理的範圍內。也正是因為如此,MCP 才能讓 Agentic AI 從概念走向實務。

MCP × AI Studio 如何把 Agentic AI 帶進企業

MCP 確保 AI 能否安全、可控地連接起內外的資料與系統,但在實際導入現場,企業很快就會遇到下一個關鍵挑戰:當 AI 已經能讀資料、調工具之後,該如何真正參與決策?除了能不能連線,更重要的是「誰可以看、誰可以用、可以做到什麼程度」。不是所有 AI 在任何情況下都能看到一樣的資料、做一樣的事,而是會依照工作內容、使用情境與企業規範,被限制在對應的範圍內。有些情況只允許它讀資料、不做改動;有些情況,才會在清楚規範下,開放它協助執行行動。這樣的設計,讓 AI 參與工作流程的同時,也不會越界碰到不該碰的資訊或權限。

這正是 Profet AI 所提出的 AI Studio 代理式 AI 協作軟體(以下簡稱 AI Studio)所扮演的角色。AI Studio 讓多個具備不同任務與專業的 AI Agent,能在同一個工作流程中分工合作、彼此驗證,並將模型輸出的結果轉化為企業可以採取的行動,同時也確保每個 AI 只在被允許的範圍內行動。。

HR 是其中一個常見的應用場景。面對招募與留才的長期壓力,企業真正的困難,往往不在於資料不足,而在於這些資料難以轉化為可預測、可行動的判斷依據。

在 AI Studio 的架構下,HR 不再只是事後查看報表,而是能與 AI Agent 協作進行判斷。例如在招募或留才情境中,AI 可以在安全可控的前提下,分析歷史資料並預測留任風險,讓 HR 有機會在關鍵決策前,或問題發生前提早介入。

由於 HR 資料本身高度敏感,不是每個角色、每個情境都能看到全部內容,而是透過 MCP 的權限控管與 AI Studio 的協作設計,AI 只能在被允許的情況下接觸對應的應用,該看的才能看,該動的才能動,資料主導權仍然掌握在企業手中,AI 成為內部決策的輔助能力,而非額外的風險來源。

從製造現場到 HR 的核心決策,MCP 為 Agentic AI 打開了進入企業系統的大門,而 AI Studio 則讓這些 AI 能在同一個環境中協作、推理並形成判斷。當 AI 不再只是查資料的工具,而是能預測風險、輔助決策並提出行動建議,代理式 AI 才真正走進企業價值鏈的核心。